Actualidad informática

Noticias y novedades sobre informática

Vigencia del Test de Turing

Alan Turing (1912-1954), famoso matemático inglés, fue uno de los creadores de la moderna computación junto con Von Newmann, y Shannon entre otros.

Alan Turing (1912-1954), famoso matemático inglés, fue uno de los creadores de la moderna computación junto con Von Newmann, y Shannon entre otros.

En la Segunda Guerra Mundial descubrió el código de Enigma, la máquina de criptografía de los nazis y formuló la máquina de Turing. En su artículo “La maquinaria de la computación y la inteligencia” planteó el llamado Test de Turing.

El final de Turing fue trágico siendo condenado por homosexualidad. Optó por la castración química frente a la cárcel. Dos años después se suicidó.

Hace más de medio siglo Alan Turing se planteó la pregunta ¿Pueden pensar las máquinas? Para no tener que resolver la ambigüedad de los conceptos máquina y pensar, diseñó una prueba que sustituyera a la citada pregunta creando con ello el célebre Test de Turing.

Predijo en los años 50, que a final del siglo XX los ordenadores podrán superar el juego de imitación. No ocurre antes no porque el hardware no sea potente sino porque hay que programar las máquinas y eso llevará 50 años. La predicción de Turing es completamente errónea. Ni las máquinas actuales ni las de un futuro próximo ni mucho menos las de su época pueden remotamente superar el Test de Turing en una tarea verbal como propone.

Creo que a finales del siglo el uso de las palabras y la opinión educada general se habrán modificado de tal manera que se podrá hablar de máquinas que piensan sin esperar que lo contradigan.

A menudo se da importancia al hecho de que las computadoras digitales son eléctricas y que el sistema nervioso también lo es. Puesto que la máquina de Babbage (anterior a Turing) no era eléctrica y puesto que todas las computadoras digitales son equivalentes en cierto sentido, observamos que el uso de la electricidad no puede tener importancia teórica.() Si realmente deseamos encontrar tales semejanzas, deberíamos buscar analogías matemáticas en el funcionamiento.

Las consecuencias de que las máquinas pensaran serían demasiado terribles. Esperemos y creamos que no pueden hacerlo.() Nos gusta creer que el hombre es, en cierto modo, superior al resto de la creación, pero sería mejor si pudiéramos demostrar que es necesariamente superior, puesto que así no habría peligro de que perdiera su posición dominante.

A fecha de hoy el Test de Turing está lejos de ser superado por ningún ordenador en un entorno de lenguaje natural sin restricciones.

Sin embargo, si usamos el test en tareas concretas, un ordenador lo superará en muchos casos. Cada vez más y más sorprendentes. De modo que sugiero reformular el Test de Turing de la siguientes manera:

Un ordenador supera el Test de Turing para una tarea X cuando un juez humano no pueda distinguir entre un concursante humano y un concursante ordenador ejecutando la tarea X

¿En qué tareas un ordenador supera el test?

- Cuanto más acotada sea la tarea, más posibilidades tiene un ordenador de superarla. En los entornos de ejecución abiertos, que por su naturaleza no han sido programados por completo, fracasará con mayor facilidad.

- Los ordenadores están construidos por humanos para que les descarguen de trabajo, realizando tareas humanas. Por ello superan el test en multitud de tareas. Por ejemplo todas las tareas de informática empresarial: contabilidad, control de almacén, nóminas, cálculos diversos…

- Matemáticas. El propio Turing advirtió que ya en su tiempo lo único adicional que debería requerir un programa matemático era ralentizar su respuesta e introducir algún error para confundir al juez humano.

- Ajedrez. En 1997 Deep Blue ganó a Garry Kasparov estableciendo un nuevo escenario en la relación hombre máquina. Hoy los programas comerciales modernos no solo ganan a cualquier maestro, sino que ajustan su nivel (juegan deliberadamente peor) al de su contrincante para no desanimarle.

- Música. Puedes bajarte una composición del programa Emmy al estilo Bach. Una audiencia especializada no distinguió si el compositor era Bach o Emmy.

- Poesía. Aunque los ordenadores están lejos de crear largos textos en prosa, pueden confundir en un poema corto:

Velada , velada , gozosa ,gozosa.

¡Señor! , cuán estrechamente el pretendiente expira.

Los vapores son sensatos cuando un masculino hechizo

canta sosegadamente .

El sonido es una marea gozosa que gime perdidamente

junto a los serenos veleros.

Una caricia en la noche , helada , es una encantadora y helada poesía. Velada , velada , gozosa ,gozosa .

¡Oh! , cuán calmadamente un ganador vive. - Reconocimiento de caras. Poco a poco se van adentrando en este terreno. Policías del mundo están usando estos programas que empiezan a estar disponibles en smartphones y ordenadores domésticos.

- Síntesis de voz. Disponible desde hace tiempo,se va refinando. Aun distinguimos con claridad una voz humana de una sintética.

- Reconocimiento de voz. Asignatura pendiente donde el camino por recorrer es aún grande. Su importancia comercial es enorme y en los últimos meses el avance es espectacular.

- Lenguaje natural. Watson, Es el enfoque más ambicioso de los últimos tiempos. Watson supera el test en la tarea “jugar en el concurso televisivo Jeopardy” No es un entorno abierto, pero el avance en “entendimiento” de lenguaje natural es asombroso.

Artículo completo en: ALT1040

Bajo licencia Creative Commons

Los manuscritos de Newton disponibles en internet

La Cambridge Digital Library ha escaneado y pasado a formato digital los Principia Mathematica de Isaac Newton, la obra más importante del científico inglés que introdujo a la Física en la modernidad. Son los manuscritos de Newton con sus anotaciones así como un cuaderno de juventud del científico (The Waste Book) en donde fue anotando cálculos e ideas. En la actualidad están disponibles unas cuatro mil páginas digitalizadas pero se espera ampliar el contenido durante el próximo año. Se puede encontrar más información en: Cambridge Digital Library y Papers of Sir Isaac Newton (Add. 3958-4007 and 9597) .

La Cambridge Digital Library ha escaneado y pasado a formato digital los Principia Mathematica de Isaac Newton, la obra más importante del científico inglés que introdujo a la Física en la modernidad. Son los manuscritos de Newton con sus anotaciones así como un cuaderno de juventud del científico (The Waste Book) en donde fue anotando cálculos e ideas. En la actualidad están disponibles unas cuatro mil páginas digitalizadas pero se espera ampliar el contenido durante el próximo año. Se puede encontrar más información en: Cambridge Digital Library y Papers of Sir Isaac Newton (Add. 3958-4007 and 9597) .

Robert Noyce, inventor del circuito integrado es el homenajeado por Google en su doodle

En el buscador de Google aparece hoy un chip que forma su doodle y pulsándolo conduce hasta la página donde se muestra información relacionada. Hoy Google rinde homenaje con este doodle en forma de microchip al creador de este tipo de elemento, Robert Noyce, que actualmente es la base de casi todos los .dispositivos que se usan en cualquier ámbito de la actividad humana El reconocimiento de este invento se dio tanto a Robert Noyce como a Jack Clair Kilby.

Robert Noyce además fue cofundador de la empresa Intel fabricante de microprocesadores habituales en los ordenadores y que son el núcleo de estas máquinas. Hoy 12 de diciembre se cumplen 84 años desde el nacimiento de este científico que falleció a los 62 el año 1990.

El primero de estos microchips llegó al mundo en 1961 y en año 1964 algunos de estos microprocesadores ya contaban con 32 transistores, que parecen ridículo si los comparamos con los más de 700 millones que poseen los últimos Intel Core i7.

Estos datos también nos sirven para darnos cuenta de la gran evolución que ha sufrido la tecnología en este último medio siglo.

Fuente: es.wikipedia.org

Hublot Reconstruye el famoso Mecanismo de Antikythera

Descubierto en 1901, el Mecanismo de Antikythera ha sido durante mucho tiempo considerado como uno de los primeros ordenadores. Durante años los científicos no tenían idea de lo que hizo, atribuyéndole una funcionalidad casi mística. Mediante el uso de técnicas avanzadas de imagen, ahora sabemos que este trozo de metal crujiente, corroído era en realidad un ordenador astronómico que permitía a los antiguos griegos predecir el paso de los planetas.

Relojería Hublot ha recreado el mecanismo utilizando técnicas modernas y se redujo hasta casi el tamaño de un sello de correos. El nuevo reloj – uno de una clase – cuenta con el mecanismo completo que los historiadores y los científicos descubrieron, junto con un estándar de tres mano tourbillon, así como un registro de fechas. Luego se pone un poco salvaje:

Las indicaciones de varios conocidos de la «máquina» Antikythera se han reproducido fielmente en su moderna contraparte, tanto en el frente y en la espalda. La cara principal del movimiento muestra: el calendario de los juegos panhelénicos (que designó esas ciudades sede de los Juegos), el calendario egipcio (12 meses cada uno de 30 días, con la epagomenal, o adicional, la posición del sol en las constelaciones del zodiaco, las fases de la Luna (con la apertura que muestra la posición de la Luna en el zodíaco sideral durante todo el mes), así como el año sideral. La parte de atrás del movimiento de relojería muestra el ciclo de Callippic, el ciclo metónico, el ciclo de Saros y el ciclo Exeligmos.

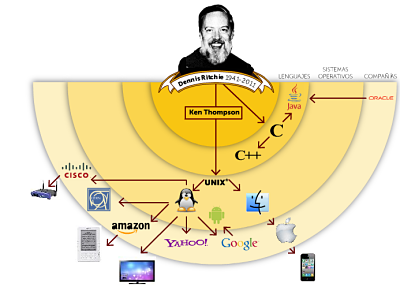

¿Qué podemos aprender de Dennis Ritchie?

Como se ha difundido por diversos medios de comunicación, uno de los padres fundadores de UNIX y el creador del lenguaje C, Dennis Ritchie, falleció el ocho de octubre. Aunque creo que muchos en la informática y otros campos relacionados sabía de la importancia de Ritchie para el crecimiento y desarrollo de todo lo relacionado con la informática, creo que es valioso mirar hacia atrás en sus logros y ubicarlo en lo alto en el panteón de las ciencias de la computación, ya poblado por Lovelace, Turing, y (aunque este canto será controvertido, al menos hasta que la historia tenga algo que decir) el recién fallecido Steve Jobs.

UNIX fue uno de los primeros sistemas operativos multiusuario, permitiendo a los científicos e investigadores compartir tiempo de computadora en lo que se ha basado tradicionalmente en el proceso por lotes en las máquinas. El concepto de múltiples usuarios y múltiples tareas fueron de gran interés para los investigadores, simplemente por el tiempo necesario para escribir, ejecutar y recibir los resultados de los programas por lotes. El tiempo en la computadora, en modo batch, era caro, como esta anécdota ilustra:

Aunque reflexionando sobre los problemas de los sistemas operativos en 1969, Ken Thompson [el cocreador de Unix] en su tiempo libre desarrolló un juego de computadora llamado «Viaje Espacial». El juego simula el movimiento de los planetas del sistema solar. Un jugador podía viajar entre los planetas, disfrutar del paisaje, e incluso aterrizar la nave en los planetas y las lunas.

El juego, primeramente escrito en Multics y luego transcrito a Fortran para el sistema operativo GECOS, corrió en un equipo GE 635. La pantalla del juego fue desigual y difícil de controlar debido a que el jugador tenía que teclear comandos para controlar la nave. Además, costaba alrededor de 75 $ en tiempo de CPU en el gran GE 635, un costo elevado.

A los 75 dólares el juego, sobre todo en dólares de 1960, era difícil para un hacker tener diversión.Dennis Ritchie y Thompson trabajaron juntos para construir UNIX como el paraíso de un hacker, un lugar para poner a prueba los programas y compartir los resultados. Él era físico y matemático de formación, pero entró en el mundo emergente del mainframe y la microinformática en el momento justo. Los años 1960 y 1970 fueron una época de grandes cambios en la manera de interactuar con la informática. Considerando que el punto de vista común es que «Estas computadoras malditas va a estropear mi cuenta de teléfono», en realidad las computadoras fueron arruinando el status quo. En unos pocos años, los registros en papel se erosionaron lentamente por el cómputo, centrales telefónicas fueron cambiando de naturaleza, hacia un sistema cuasimecánico de routers y terminales. Los laboratorios Bell estaban a la vanguardia de todo esto, la tarea de conectar el mundo a través del cable de cobre. Lo más importante es lo que estaba haciendo era difícil, algo que se ha olvidado en los días de arrastrar y soltar.

La clave para UNIX fue el concepto de compartir. El sistema operativo se inició en 1969 como una reacción de los Laboratorios Bell de cerrar Thompson y el sistema operativo favorito de Ritchie, Multics. Con la colaboración de varias organizaciones incluyendo el MIT, un grupo de cuatro, programadores de New Jersey Bell Labs comenzaron a trabajar en un equipo olvidado de la máquina PDP-7 en el que se portó el juego de los viajes espaciales y comenzaron a construir un sistema de archivos para guardar los juegos. Poco a poco, crearon una estructura de comandos que cualquiera que esté familiarizado con Linux modernos se entiende por acreción en torno a este sistema de archivos. Poco a poco la palabra UNIX corría fuera de la pequeña camarilla de los usuarios originales y en 1971 los Bell Labs comenzaron a utilizalor para dar formato a los documentos con nroff .

También es importante tener en cuenta que Linus Torvalds nació en 1969, haciendo de él un candidato ideal para aprovechar los beneficios de lo que podríamos denominar la era UNIX. La mayoría de edad en el tumulto de una nueva industria es importante y Gates, Torvalds, y Ritchie todos fueron excelentes ejemplos de esto.

Ritchie llegó a crear una serie de otras mejoras y, en el desarrollo del sistema operativo C, le dio al mundo su primer multimáquina, con el estándar de codificación que cualquier persona, desde un veterano canoso de lenguaje máquina a un joven estudiante en Helsinki , podrían usar y comprender. El código fuente de UNIX pasó de programador a programador, como la «Sagrada Escritura», incluso después AT & T se negó a ponerlo a disposición de las instituciones de educación. Fue escrito en C con algunos de sus componentes básicos escritos en lenguaje máquina para ganar tiempo en los ciclos, y lo más importante, para mantener una elegancia que Ritchie y Thompson han inculcado a través de la polinización cruzada de ideas. Ningún hombre, ni siquiera Ritchie, entiende la complejidad de la bestia que se convirtió en UNIX y que fue por el diseño. El objetivo era la simplicidad de frente y complejidad en el interior, un modelo que todo el mundo de la informática harían bien en emular.

También fue importante el deseo de alcanzar un ideal de oro en la claridad y la elegancia. «La presión de grupo y el simple orgullo de la mano de obra ha causado que montones de código sea reformado o desechado frente a ideas surgidas mejores o más básicas», escribió Doug McIlroy, un miembro del equipo de UNIX. «Rivalidad profesional y la protección eran prácticamente desconocidas: tantas cosas buenas estaban ocurriendo que nadie debía tener la propiedad sobre las innovaciones».

La pregunta es, entonces, ¿qué podemos aprender acerca de la construcción de nuestros propios productos de este gigante de la informática? En primer lugar, Ritchie y Thompson querían divertirse. No hubo impulso inicial de hacer dinero y, de hecho, su objetivo era ahorrar dinero o al menos ocultar su juego para que pase a un equipo menos costoso.

El segundo es la necesidad de trabajar fuera de su zona de confort. Ritchie fue un físico y un matemático. Sin embargo, se convirtió en un programador. Si bien es claro que sus antecedentes le ayudóaron enormemente en la creación de UNIX y C, como Bjarne Stroustrup señaló , Ritchie no tuvo miedo de intentar trabajar en un territorio nuevo y desconocido. «Si Dennis había decidido pasar de esa década en las matemáticas esotéricas, Unix habría muerto», escribe.

Tercero, la importancia de un enfoque de no intervención a la innovación. Ritchie tuvo la suerte de que los Laboratorios Bell tenían el dinero y el personal que le permitía esconderse en las sombras con sus amigos, creando lo que querían en su propia línea de tiempo. Google parece haber capturado el mismo sentido de la experimentación interna, obviamente, con sus proyectos del 20%, así como sus productos de los laboratorios que poco a poco se transforman en herramientas convencionales. Que los fundadores de Google permitan a estos proyectos un 20%, casi inmediatamente después de la creación de la empresa es un testimonio de Thompson y la metodología de Ritchie. Las personas tienden a construir herramientas cuando el capataz está observando y obras de arte cuando se le deja a su suerte.

Por último, tenemos la importancia de compartir. Me divierte sin fin ver una pequeña start-up encubrir sus productos detrás de acuerdos de confidencialidad y el secreto o intentar confundir los empresarios contentos. Cuando esto sucede, está claro que su idea no es nueva ni será un éxito particular, ni su actitud es particularmente propicia para el crecimiento. Yo diría que muchos empresarios actuales, tiene un producto de éxito pero no tienen éxito porque hablan mucho y no saben jugar.

Podría decirse que el proyecto de software más importantes en el mundo de hoy, Linux, es importante porque gloriosamente está disponible y abierto. Hay quienes dirá que no es sinónimo de rentabilidad, pero esas personas son en el mejor de los casos pesimistas y en el peor necios.

Al final, Dennis Ritchie nos enseñó que la informática no era una sociedad secreta, que requiere largos años de servicio y encantamientos especiales para unirse. Su generosidad intelectual es importante sobre todo lo que hacemos en línea actualmente.

No deja ser curioso que habiendo fallecido unos días después de Steve Jobs, la crónica, con retraso, quede resumida en: Dennis Ritchie de 70 años, jubilado desde 2007, su último puesto de trabajo fue el de ingeniero jefe del departamento de Investigación en software de sistemas de Alcatel-Lucent, falleció el pasado fin de semana, víctima de una larga enfermedad. Fue premio Turing en 1983 por la teoría de sistemas operativos genéricos y recibió la Medalla Nacional de Tecnología de EEUU en 1998.

Fuente: TC

¿Quién era Dennis Ritchie?

Gracias a Dennis Ritchie funcionan dispositivos electrónicos como los iPhones (Apple), nuestras conexiones ADSL o instituciones como el CERN. El pasado fin de semana falleció a los 70 años de edad uno de los más influyentes ingenieros informáticos, capaz de sentar las bases de la informática moderna.

autobus las palmas aeropuerto cetona de frambuesa